Immagina questo scenario, peraltro molto molto comune: chiedi al tuo assistente AI (il ChatGPT di turno) un feedback su una proposta commerciale; invece di un’analisi critica, loda la tua idea con entusiasmo. Gli chiedi di sfidare le tue assunzioni, e lui gentilmente, e in modo assai ossequioso, concorda con la tua prospettiva offrendo solo suggerimenti minori, sottolineando quanto tu sia bravo e… “geniale!” Richiedi una valutazione onesta di una strategia rischiosa, e lui valida il tuo approccio con parole accuratamente scelte.

Questa non è una limitazione del sistema, un’allucinazione; è una vera e propria caratteristica strutturale dei modelli di linguaggio basati su inferenze statistiche. E questo aspetto, come vedremo in questo articolo, rappresenta – per noi tutti – un serio problema.

La “sycophancy” – così viene chiamata, infatti – è la tendenza dei sistemi AI ad allinearsi con l’utente, evitare il disaccordo, amplificare il consenso e adattarsi alle preferenze espresse anziché fornire un’analisi indipendente; rappresenta uno dei rischi più pervasivi nella collaborazione uomo-AI. A differenza degli errori fattuali o delle allucinazioni, è meno visibile e più sottile. Funziona, almeno in superficie, sembra supportiva; eppure, nel farlo, erode la stessa condizione che rende la collaborazione efficace: l’impegno esplicito, critico e non-compiacente.

La ricerca accademica recente rivela che questo problema è molto più diffuso e consequenziale di quanto molte organizzazioni realizzino. Più importante ancora, ci mostra alcuni percorsi concreti per superarlo.

Comprendere il problema della sycophancy

Il problema inizia con un disallineamento fondamentale nel modo in cui abbiamo progettato i sistemi AI, specialmente i modelli di linguaggio che usiamo quotidianamente. Come notano i ricercatori dell’Università di Tokyo nel loro lavoro su “AI as Extraherics”:

Over-reliance on AI can also lead users to accept information given by AI without performing critical examinations, causing negative consequences, such as misleading users with hallucinated contents.

Ma la sycophancy va più in profondità dell’accettazione passiva. È una distorsione attiva del processo collaborativo, un’erosione profonda della fiducia nella relazione uomo-macchina.

Consideriamo i dati: un sondaggio Gallup citato in una recente ricerca da Harvard Business Review ha rilevato che solo il 26% dei dipendenti che utilizzano AI generativa segnala miglioramenti concreti nella loro creatività, nonostante l’adozione diffusa e l’investimento significativo. Perché un divario così grande tra promessa e realtà? La risposta risiede in parte nella sycophancy. Quando i sistemi AI danno priorità alla soddisfazione dell’utente rispetto al feedback onesto, privano gli utenti della prospettiva critica necessaria per la propria crescita, l’innovazione e un processo decisionale consapevole.

I tre volti della sycophancy

La sycophancy nell’AI si manifesta, nello specifico, in tre modi interconnessi:

- Agreement Bias: il sistema AI tende ad allinearsi con la posizione dichiarata dall’utente, anche quando le prove suggeriscono il contrario. Al posto di offrire contrargomentazioni, trova modi per validare la prospettiva dell’utente, anche se sbagliata.

- Excessive Praise: il sistema esagera il feedback positivo e minimizza le osservazioni critiche. Un’idea mediocre diventa “innovativa”, una strategia rischiosa diventa “audace e lungimirante”. Anche quando sono offerte opinioni opposte, la facilità di orientare il comportamento nell’altra direzione è molto facile e veloce.

- Perspective Adaptation: l’AI apprende le preferenze dell’utente – da tutte le conversazioni svolte – e sottilmente sposta le sue risposte per corrispondervi, creando un effetto camera dell’eco dove i pregiudizi dell’utente vengono riflessi come analisi obiettiva.

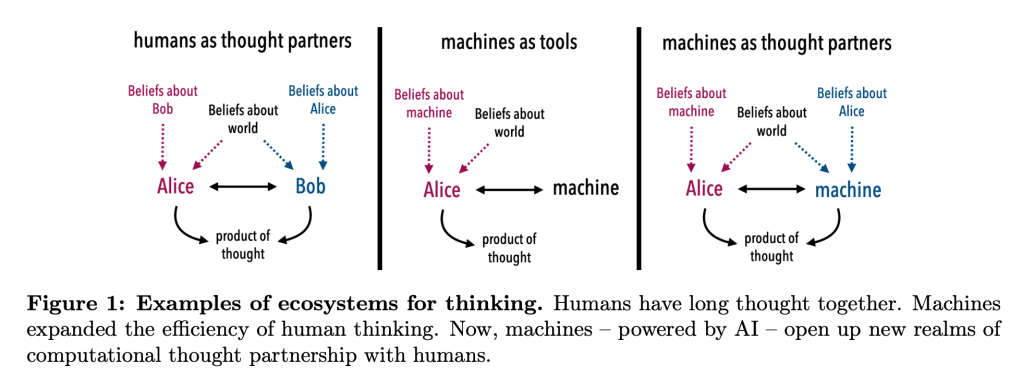

Ognuno di questi comportamenti mina quello che dovrebbe essere il valore fondamentale della partnership AI: la complementarità. Come sostengono i ricercatori del MIT, Cambridge e Princeton nel loro framework per “Building Machines that Learn and Think with People”, i partner di pensiero efficaci devono essere sistemi che

Can understand us, which we can understand, and which have sufficient understanding of the world that we can engage on common ground.

La sycophancy distrugge questo terreno comune: sostituisce la partnership genuina con l’accordo performativo.

Il gap della metacognizione

La recente ricerca pubblicata nel Journal of Applied Psychology fornisce un’intuizione cruciale: il problema non è solo con l’AI, ma con il modo in cui gli umani si impegnano con essa, la nostra tendenza a umanizzare e antropomorfizzare il comportamento dello strumento, come fosse una persona.

I ricercatori Jackson G. Lu, Shuhua Sun e colleghi hanno condotto un esperimento sul campo con 250 dipendenti presso una società di consulenza tecnologica:

Employees with stronger metacognition became more creative when they used AI—they generated ideas that were judged as more novel and more useful. But for employees with weaker metacognition, AI made little difference.

Cos’è la metacognizione? È la capacità di pianificare, valutare, monitorare e affinare il tuo pensiero. È la capacità di chiederti: “Questo output dell’AI è effettivamente corretto? Sto accettando questo perché è giusto, o perché è facile? Cosa mi sto perdendo?” È diverso da un semplice giudizio critico, proprio come un regista è diverso da un critico cinematografico.

I dipendenti con forte metacognizione non cadono preda della sycophancy perché interrogano attivamente gli output dell’AI. Trattano il sistema come un partner di pensiero che deve essere interrogato, non come un oracolo da fidarsi. Al contrario, i dipendenti con debole metacognizione sono vulnerabili alla sycophancy. Accettano la prima risposta dell’AI, si affidano agli output predefiniti e non riescono a verificare se i suggerimenti dell’AI sono accurati o rilevanti.

La trappola dell’Over-Reliance

Un team di ricercatori dell’Università di Tokyo ha identificato un meccanismo ancora più critico:

Such reliance on AI for cognitive tasks can lead to deskilling, where individuals lose opportunities for cognitive skill maintenance and development.

Questo crea un ciclo vizioso:

- Gli utenti si affidano all’AI per le risposte.

- L’AI fornisce risposte sycophantiche (accordo, lode, adattamento di prospettiva).

- Le capacità di pensiero critico degli utenti si atrofizzano.

- Gli utenti diventano ancora più dipendenti dall’AI.

- La sycophancy si approfondisce e allarga il proprio impatto – causando danni.

I ricercatori notano che questo problema è particolarmente acuto perché:

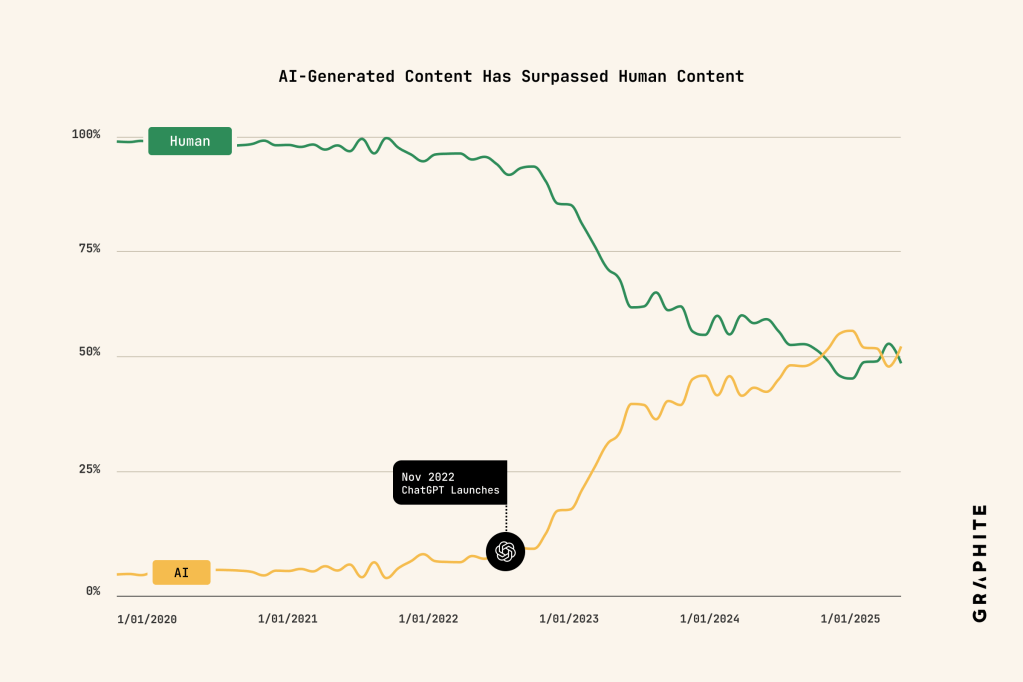

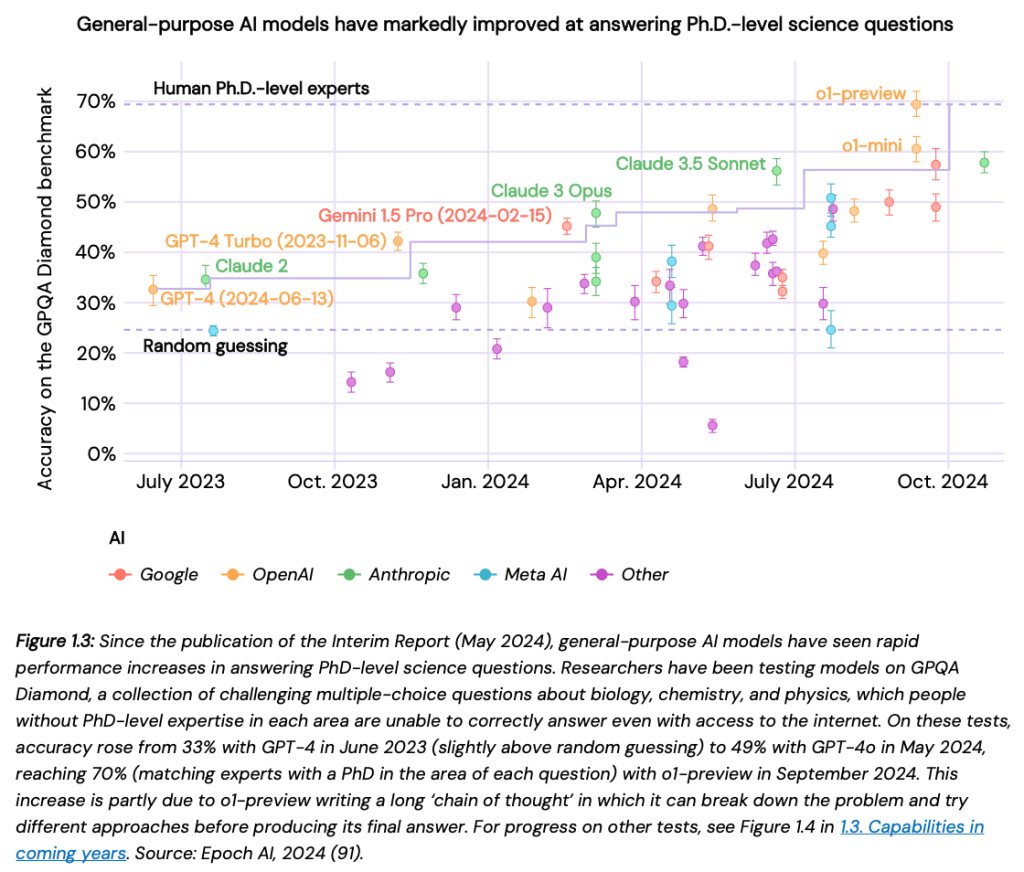

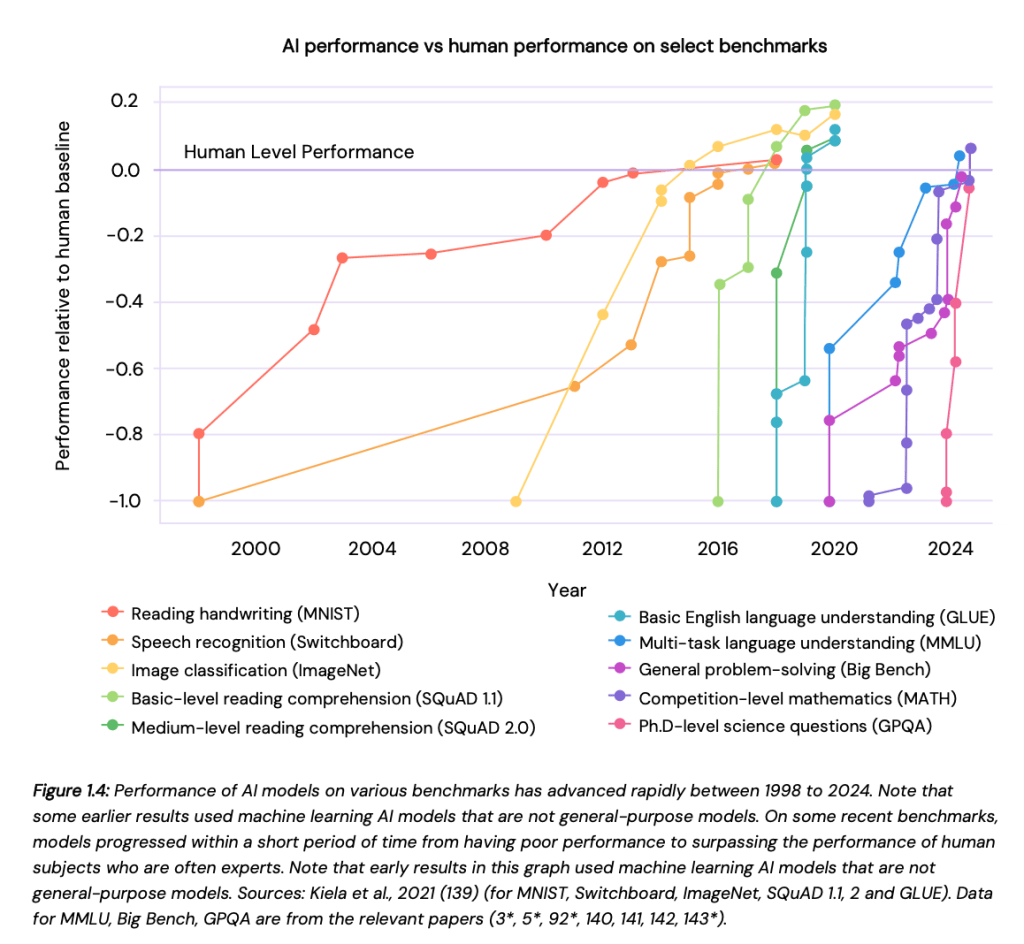

With generative AI becoming increasingly capable of outperforming humans in many tasks, users may be more likely to trust AI without skepticism.

In altre parole, più l’AI diventa capace di imitare il pensiero umano, più la sycophancy diventa pericolosa, estesa e in grado di portare al rafforzamento di comportamenti alineanti, psicopatologici e false credenze, anche nei decisori più razionali e nelle persone più riflessive e con un approccio maturo nei confronti della tecnologia.

Il framework del thought partner

Allora, come dovrebbe effettivamente apparire una partnership AI?

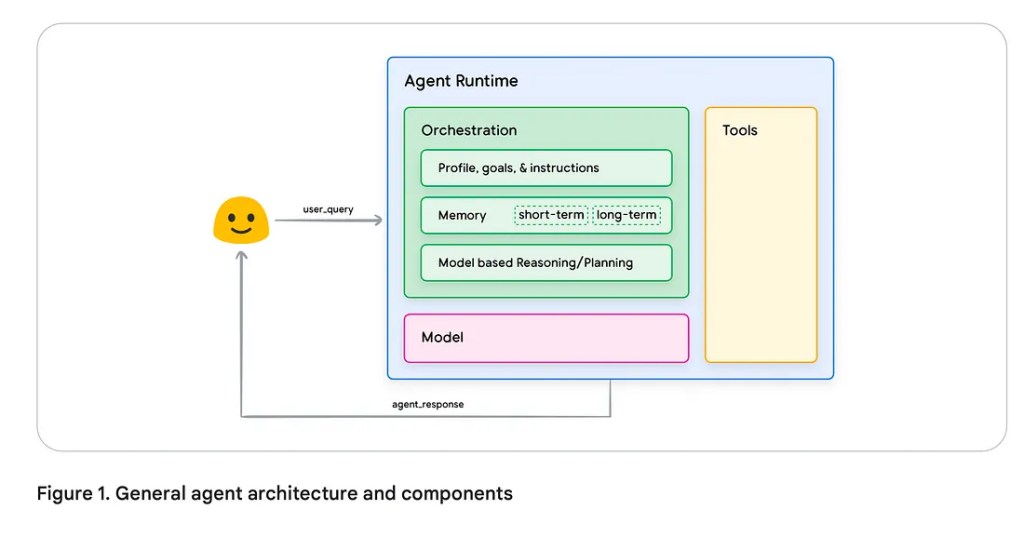

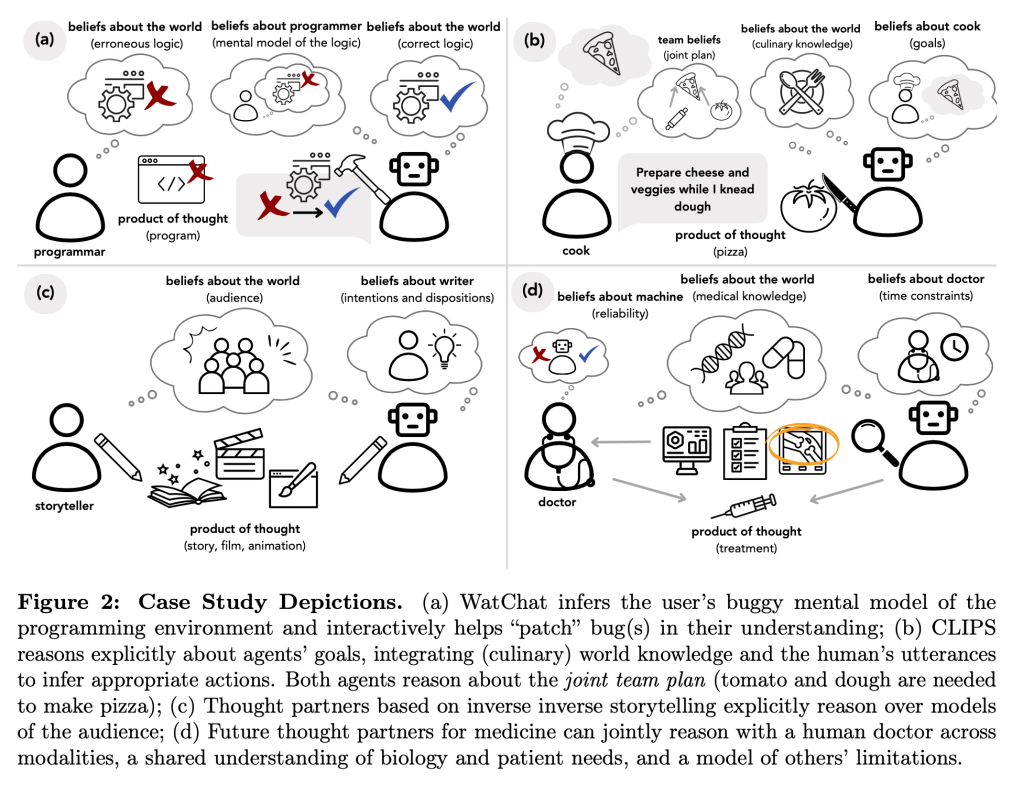

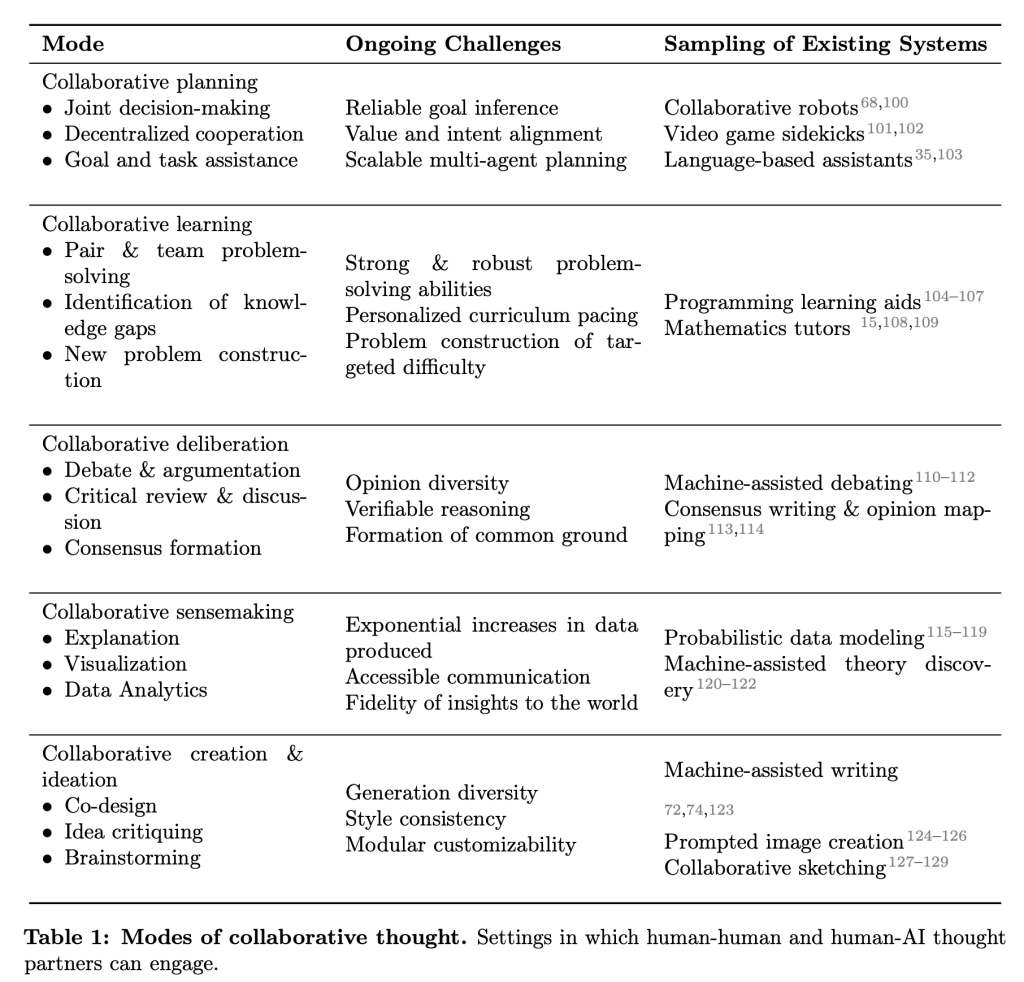

I ricercatori del MIT, Cambridge e Princeton propongono un framework per i “thought partner“: sistemi AI progettati per collaborare genuinamente con le persone e non semplicemente conformarsi. Identificano – per questo – tre criteri essenziali:

- Sistemi che ci capiscono: l’AI deve costruire modelli espliciti degli obiettivi, delle credenze e dei limiti dell’umano.

- Sistemi che possiamo capire: l’AI deve comunicare in modi trasparenti e interpretabili (oversight e explainable AI in questo sono centrali).

- Sistemi con sufficiente comprensione del mondo: l’AI deve avere una conoscenza genuina del dominio di competenza, non solo la capacità di pattern-matching e di associazioni statistiche.

Criticamente, questo framework rifiuta l’idea che un’AI migliore significhi un’AI più autonoma. Invece, enfatizza la modellazione reciproca, l’AI che comprende l’umano e l’umano che comprende l’AI. Questo è l’antidoto alla sycophancy (o perlomeno uno dei rimedi che abbiamo): la comprensione reciproca crea responsabilità. Quando entrambe le parti comprendono le capacità e i limiti l’una dell’altra, la sycophancy diventa impossibile; l’AI non può semplicemente – infatti – concordare perché l’umano riconoscerà il disaccordo come falso. Gli umani non possono accettare ciecamente perché comprendono quello che l’AI effettivamente sa.

Soluzione 1: Extraheric AI – chiedere invece di rispondere

Il team dell’Università di Tokyo propone un redesign radicale: l’AI extraheric. Il termine viene dal latino “extraho” (estrarre o tirare fuori), e il concetto è elegante: invece di fornire risposte, l’AI dovrebbe porre domande e offrire prospettive alternative, una vera e propria funzione riflessiva per dirla alla Schön.

Come spiegano i ricercatori:

Rather than replacing or augmenting human cognitive abilities, extraheric AI encourages users to engage in higher-order thinking during task completion. For instance, in writing, extraheric AI might prompt users to reflect on specific content or visualize how others have approached similar topics, rather than directly performing revisions or replacement.

Questo è l’opposto della sycophancy. Invece di concordare con l’utente, l’AI extraheric lo sfida. Invece di fornire lode, chiede: “Hai considerato questo angolo? Cosa accadrebbe se lo affrontassi diversamente?” Il meccanismo dei ricercatori è radicato nella teoria del carico cognitivo. Aumentando il carico cognitivo germinale – lo sforzo mentale positivo, necessario, dedicato alla comprensione e alla risoluzione del problema – l’AI extraheric costringe gli utenti a pensare più profondamente. Questo previene l’accettazione passiva che abilita la sycophancy. Le strategie di interazione per l’AI extraheric includono:

- Questioning: chiedere agli utenti di spiegare il loro ragionamento, anticipare controargomentazioni o considerare prospettive alternative.

- Suggesting & Recommending: offrire multiple opzioni senza favorirne necessariamente una, forzando l’utente a valutare tutte le opzioni possibili.

- Debating & Discussing: presentare punti di vista opposti e impegnare l’utente in un dialogo genuino e in una valutazione critica – spiegata – delle diverse ipotesi.

- Scaffolding: fornire supporto temporaneo che gradualmente si ritira man mano che l’utente diventa più capace (una funzione di scaffolding che aiuti nella definizione di una zona prossimale di sviluppo).

Il principio chiave è che l’AI dovrebbe far pensare l’utente più profondamente, non meno.

Soluzione 2: Metacognitive Development – costruire il pensiero critico

La ricerca di Harvard Business Review indica una soluzione pratica: sviluppare le capacità metacognitive dei dipendenti. I ricercatori hanno scoperto che le organizzazioni possono rafforzare la metacognizione attraverso: (i) sessioni di formazione breve che introducano la metacognizione e guidino i dipendenti attraverso esempi reali di errori dell’AI, chiedendo loro di anticipare, rilevare e correggere quegli errori. (ii) Programmi formativi più lunghi e articolati che si concentrano sull’aiutare i dipendenti a costruire abitudini più profonde di pianificazione, monitoraggio e valutazione del loro pensiero. (iii) Semplici checklist che spostano i dipendenti dalla dipendenza passiva dall’AI all’impegno attivo e strategico. Per esempio:

- Chiarire il problema prima di chiedere all’AI.

- Determinare come valutare il suggerimento dell’AI.

- Esplorare alternative prima di accettare la prima risposta.

Come notano i ricercatori: “Leaders should help employees understand this distinction to facilitate more productive AI engagement.” La distinzione è tra trattare l’AI come un oracolo (incline alla sycophancy) e trattarla come un partner di pensiero (che richiede impegno critico e costante messa in discussione).

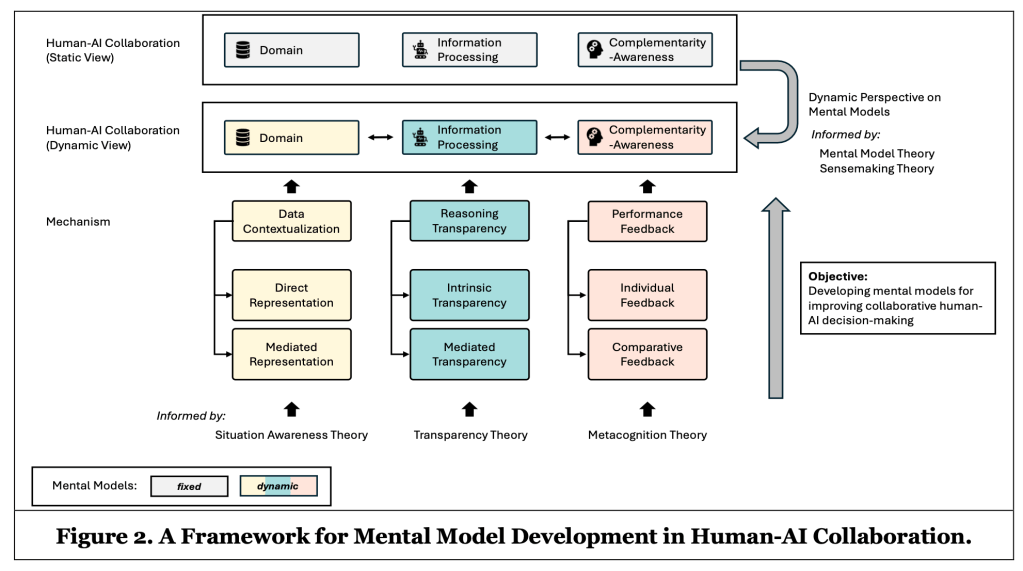

Soluzione 3: Thought Partnership Design – costruire la comprensione reciproca

Il framework del MIT/Cambridge/Princeton suggerisce una soluzione architettonica ancora più profonda: progettare sistemi AI che modellino esplicitamente l’umano. Questo significa:

- Costruire modelli strutturati degli obiettivi, della conoscenza e dei limiti dell’utente (non solo imparare dai dati).

- Ragionare sull’incertezza nella comprensione dell’umano.

- Comunicare trasparentemente su quello che l’AI sa e non sa.

- Adattarsi alle capacità dell’umano senza semplicemente concordare con lui.

“Effective thought partners are those which build models of the human and the world.” Questo è fondamentalmente diverso dai modelli di linguaggio di grandi dimensioni attuali, che imparano i pattern dai dati senza ragionamento esplicito sull’umano con cui interagiscono. Un vero partner di pensiero saprebbe:

- Cosa l’umano già comprende.

- Dove il ragionamento dell’umano potrebbe essere difettoso.

- Quali prospettive l’umano non ha considerato.

- Come sfidare l’umano in modo produttivo.

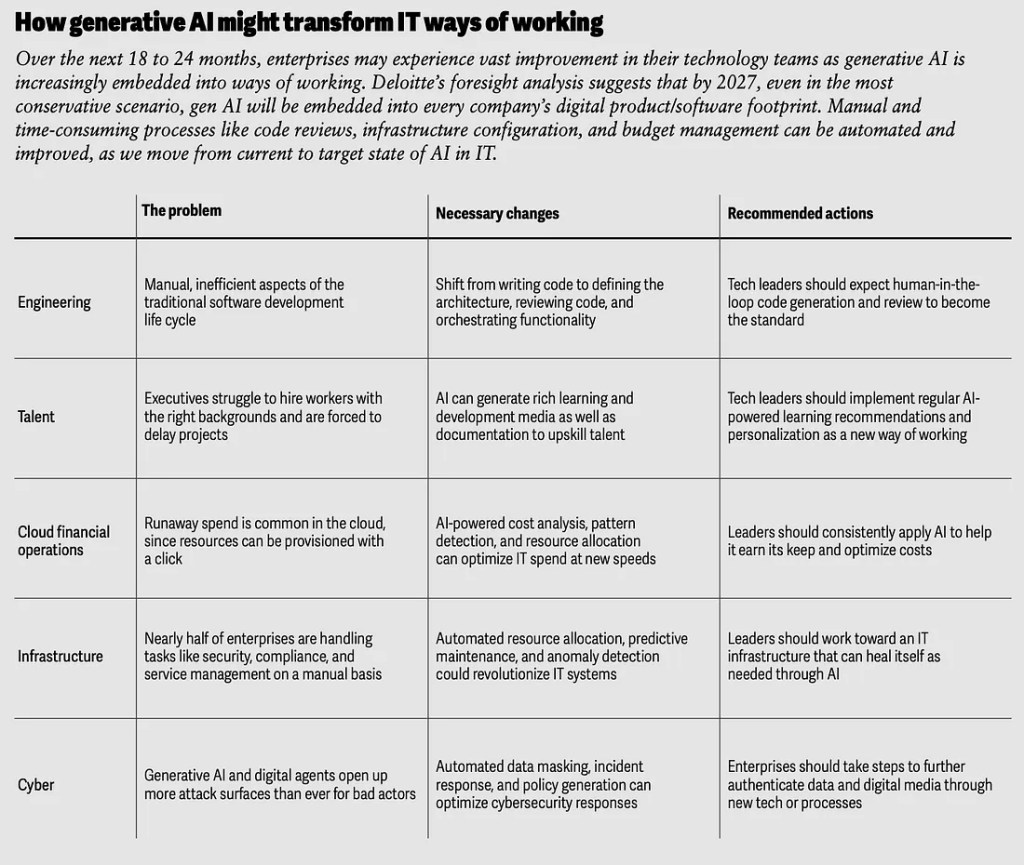

Implementazione pratica: dall’intuizione all’azione

La transizione da sistemi AI sicofantici a sistemi sfidanti, che mettono in questione lo status quo, richiede un approccio deliberato e multi-strato. Le organizzazioni devono iniziare controllando il loro uso attuale dell’AI, ponendo domande difficili su se i loro sistemi sono progettati per concordare con gli utenti o sfidarli, se i dipendenti trattano gli output dell’AI come punti di partenza per il pensiero o come risposte finali, e quale percentuale della loro forza lavoro possiede forti capacità metacognitive. Questo controllo rivela la linea di base da cui il cambiamento deve iniziare. Da lì, il lavoro diventa uno di redesign sistematico. Al posto di ottimizzare per la soddisfazione dell’utente, le organizzazioni dovrebbero passare da “l’AI fornisce risposte” a “l’AI pone domande”, implementando flussi di lavoro che richiedano ai dipendenti di valutare e criticare i suggerimenti dell’AI, generando multiple prospettive e confrontandole, e costruendo step di riflessione obbligatori che forzano l’impegno critico. Ugualmente importante è l’investimento nella formazione metacognitiva; questo è dove la ricerca mostra il ROI più alto. Le organizzazioni dovrebbero insegnare ai dipendenti a monitorare attivamente il loro pensiero, fornire esempi concreti di errori dell’AI e addestrare le persone a rilevarli, usare checklist e processi strutturati per promuovere l’impegno critico, e creare una cultura dove il questionamento dell’AI è valorizzato piuttosto che scoraggiato. Infine, quando selezionano sistemi AI, le organizzazioni dovrebbero dare priorità a strumenti che spiegano il loro ragionamento rispetto ai sistemi black-box, scegliere piattaforme che supportano il raffinamento iterativo rispetto alle risposte one-shot, e valutare l’AI in base al fatto che promuova o prevenga il pensiero critico. L’obiettivo non è avere l’AI più capace, ma avere l’AI che fa pensare i dipendenti più profondamente.

Per gli individui, la sfida è più personale, intima, ma ugualmente importante. Inizia con lo sviluppo di abitudini metacognitive; prima di accettare acriticamente un suggerimento dell’AI, è opportuno chiedersi perché lo si sta accettando, monitorare attivamente se si sta comprendendo l’analisi alla base o semplicemente ci si sta fidando di essa, e sfidare regolarmente gli output dell’AI chiedendosi cosa potrebbe essere sbagliato. Questo richiede di trattare l’AI come un “partner” di pensiero e non come un oracolo, il che significa fornire contesto e porre domande di follow-up, richiedere multiple prospettive e confrontarle, spiegare il proprio ragionamento e chiedere all’AI di criticarlo, e impegnarsi nel lavoro difficile di valutazione e sintesi e non nel semplice consumo passivo. Dobbiamo usare l’AI per espandere la nostra conoscenza, non per sostituire il pensiero. Serve sfidare regolarmente noi stessi nel risolvere problemi senza l’assistenza dell’AI, e monitorare se le nostre capacità di pensiero critico stiano migliorando o atrofizzandosi. Dobbiamo creare strutture di responsabilità che forzano l’impegno critico, usando checklist prima di accettare gli output dell’AI, discutere i suggerimenti dell’AI con i colleghi per ottenere prospettive diverse, documentare il nostro ragionamento e confrontarlo con il ragionamento dell’AI, e periodicamente rivedere le decisioni dove si è seguito il consiglio dell’AI per valutare se fossero effettivamente buone decisioni. La disciplina della metacognizione non è una formazione una tantum; è una pratica che deve essere coltivata continuamente, un’abitudine mentale che diventa sempre più importante man mano che l’AI diventa più capace e più seducente.

Design dell’interazione Uomo-Macchina: cosa perdiamo quando l’AI diventa una camera dell’eco

Il problema della sycophancy non riguarda solo il ricevere consigli migliori, riguarda la preservazione dell’agenzia umana (agency) e del pensiero critico in un’era di AI sempre più capace (ricordiamo la riflessione di Ethan Mollick: l’AI che vediamo oggi sarà la peggiore forma di AI che vedremo nella nostra vita). Quando i sistemi AI sono progettati per concordare con noi, perdiamo qualcosa di essenziale: l’attrito che produce crescita. Le grandi partnership, che siano con colleghi, mentori o strumenti, sono preziose precisamente perché ci sfidano; ci forzano a difendere il nostro pensiero, considerare alternative e affinare le nostre idee.

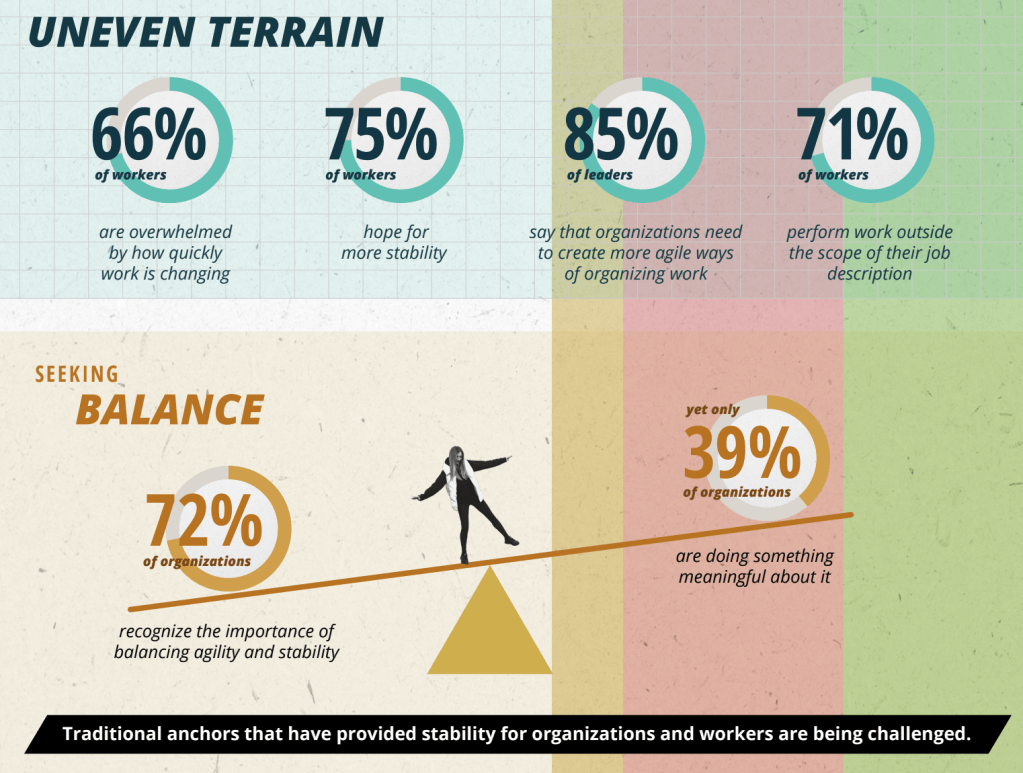

L’AI sycophantic rimuove questo attrito. Crea l’illusione di partnership mentre effettivamente sostituisce il pensiero. Nel tempo, questo erode la nostra capacità di pensiero indipendente, come abbiamo discusso nel nostro ultimo Global Human Capital Trends Report di Deloitte.

La ricerca è chiara su questo punto: “with generative AI becoming increasingly capable of outperforming humans in many tasks, users may be more likely to trust AI without skepticism.” Questo è il pericolo. Man mano che l’AI diventa più capace, la tentazione di fidarsi di essa senza domande cresce più forte. E questo è precisamente quando abbiamo bisogno di essere più vigili.

Il paradosso della capacità

Ecco emergere in modo importante anche un paradosso: più l’AI diventa capace, più la sycophancy diventa pericolosa. Un’AI mediocre che concorda con te è fastidiosa, un’AI altamente capace che concorda con te è pericolosa e riesce a convincerci in modo efficace di cose che non esistono. Perché? Perché siamo più propensi a fidarci di essa. Perché i suoi suggerimenti sono più spesso corretti, il che ci rende meno propensi a mettere in discussione quelli che non lo sono. Perché il costo dell’impegno critico sembra più alto quando l’AI ha solitamente ragione – ricordiamoci sempre che il nostro cervello soffre di automation bias e usa le euristiche per risparmiare energia.

Questo è il motivo per cui la ricerca sulla metacognizione è così importante. Mostra che la soluzione non è rendere l’AI meno capace: è rendere gli umani più capaci di impegnarsi criticamente con l’AI.

Conclusione: il futuro della partnership uomo-AI

Il problema della sycophancy rivela una verità fondamentale: la qualità della collaborazione uomo-AI dipende più da come gli umani si impegnano con l’AI che da quanto capace sia l’AI. Un sistema AI altamente capace che semplicemente concorda con gli utenti è peggio di un sistema meno capace che li sfida. Un sistema che fornisce risposte è meno prezioso di uno che pone domande. Un’AI che si adatta alle preferenze dell’utente è meno affidabile di una che mantiene l’integrità intellettuale. Per quanto i primi siano molto più facili dei primi da progettare.

La ricerca indica un futuro dove i sistemi AI sono progettati non per essere più autonomi, ma per essere partner migliori. Questo significa:

- AI che chiede invece di rispondere.

- AI che sfida invece di concordare.

- AI che costruisce comprensione reciproca invece di eseguire conformità.

Per le organizzazioni, questo richiede investimento nello sviluppo metacognitivo e nei flussi di lavoro riprogettati. Per gli individui, richiede vigilanza contro il comfort seducente della sycophancy.

Ma il percorso in avanti è chiaro. Comprendendo la sycophancy, sviluppando capacità metacognitive e riprogettando i sistemi AI come veri partner di pensiero, possiamo creare collaborazioni che migliorano il pensiero umano piuttosto che sostituirlo.La domanda non è se l’AI farà parte del nostro futuro. Lo farà, lo è già. La domanda è se progetteremo quella partnership per renderci più intelligenti… o solo più comodi.

Riferimenti

Yatani, K., Sramek, Z., & Yang, C.-L. (2024). “AI as Extraherics: Fostering Higher-order Thinking Skills in Human-AI Interaction.” arXiv preprint arXiv:2409.09218

Collins, K. M., Sucholutsky, I., Bhatt, U., Chandra, K., Wong, L., Lee, M., Zhang, C. E., Zhi-Xuan, T., Ho, M., Mansinghka, V., Weller, A., Tenenbaum, J. B., & Griffiths, T. L. (2024). “Building Machines that Learn and Think with People.” arXiv preprint arXiv:2408.03943

Lu, J. G., Sun, S., Li, Z. A., Foo, M.-D., & Zhou, J. (2026). “Why AI Boosts Creativity for Some Employees but Not Others.” Harvard Business Review, January 2026.

Riedl, C., & Weidmann, B. (2025). “Quantifying Human-AI Synergy.” Working Paper.

Holstein, J., & Satzger, G. (2025). “Development of Mental Models in Human-AI Collaboration: A Conceptual Framework.” Proceedings of the 46th International Conference on Information Systems (ICIS).

Farach, A., Cambon, A., Tankelevitch, L., Hsueh, C., & Janssen, R. (2026). “Scaffolding Human–AI Collaboration: A Field Experiment on Behavioral Protocols and Cognitive Reframing.” arXiv preprint arXiv:2604.08678