Il report di Deloitte del 2026 sui Global Human Capital Trend si apre con un’affermazione netta:

“Organizations are no longer just trying to balance competing forces: They are standing at a tipping point.”

Sette leader aziendali su dieci indicano che la loro principale strategia competitiva nei prossimi tre anni sarà basata su velocità e agilità. Parallelamente, la tradizionale curva a S della crescita si sta comprimendo. L’intelligenza artificiale e la trasformazione della forza lavoro accelerano la fase di ascesa e riducono la durata dei plateau. In questo contesto, la reinvenzione assume una natura strutturale.

In questa edizione ho avuto il grande privilegio di contribuire come autore, guidando direttamente tre dei sette trend: Getting human and machine relationships right, Fact or fabrication? AI is blurring the line when it comes to people and work e AI and the future of human decision-making. Di seguito propongo una sintesi dei sette trend che strutturano la ricerca, concentrandomi sulle implicazioni strategiche per le organizzazioni.

Getting human and machine relationships right

Il report evidenzia un paradosso operativo. Quasi il 60% dei lavoratori utilizza intenzionalmente l’AI nel proprio lavoro, mentre solo il 14% dei leader dichiara di essere competente nel progettare le interazioni uomo–AI. Il 66% riconosce l’importanza del design di tali interazioni, ma solo il 6% riporta progressi significativi. Il divario tra consapevolezza ed esecuzione è ampio.

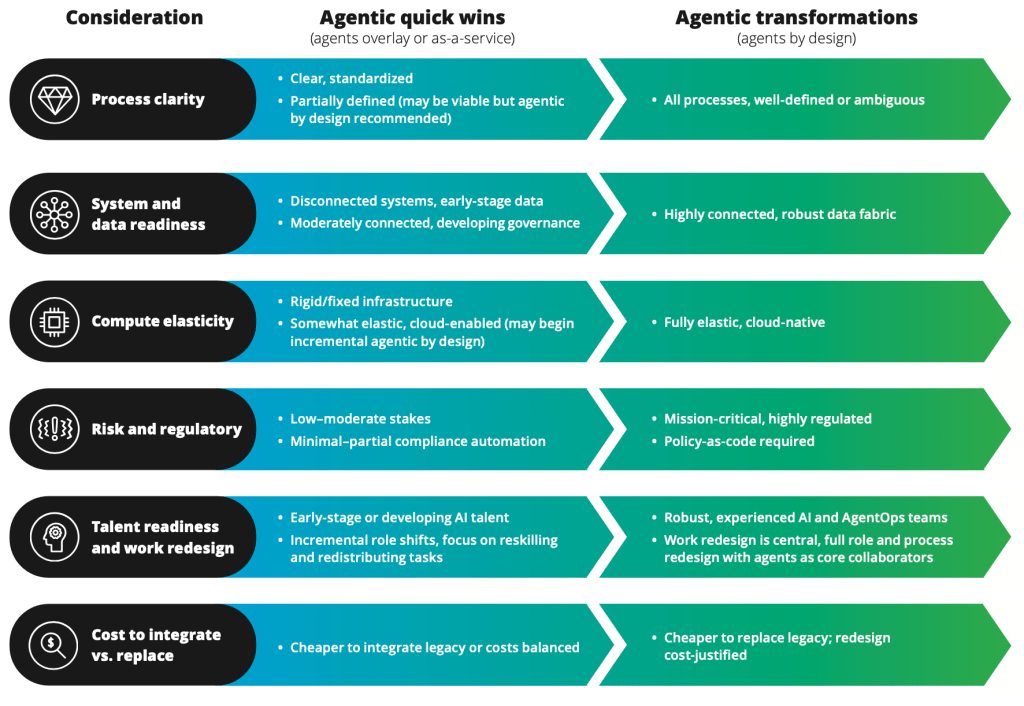

Molte organizzazioni adottano ancora un approccio centrato sulla tecnologia. Il 59% stratifica l’AI su sistemi legacy senza intervenire sul design del lavoro. Un problema evidente di accountability e definizione dei confini, che rischia di inibire la partecipazione delle persone. Come osserva il report:

“Organizations can’t count on cohesive human-AI interactions to happen organically.”

Le organizzazioni che riprogettano ruoli, workflow e processi decisionali per abilitare la collaborazione uomo–AI hanno una probabilità quasi 2,5 volte superiore di riportare migliori risultati finanziari e il doppio delle probabilità di offrire lavoro significativo. In un caso del settore telecomunicazioni citato nel report, l’introduzione dell’AI senza redesign ha generato un incremento di produttività del 5%. Quando il 90% del budget è stato investito nella riprogettazione delle interazioni, l’incremento è salito al 30%.

Direzione proposta.

Il report propone un’architettura duale. A livello macro, definire ambizione strategica, governance, principi di design e framework di fiducia. A livello micro, scegliere esplicitamente il tipo di relazione: AI assistant, coach, collaborator, direct report o autonomous worker. Hardwiring e softwiring devono evolvere in parallelo. Diritti decisionali ed escalation formali richiedono coerenza culturale, sicurezza psicologica e leadership attiva. La qualità del design della collaborazione uomo–macchina diventa un fattore distintivo.

Fact or fabrication? AI is blurring the line when it comes to people and work

Un trend a cui sono particolarmente affezionato ci interroga su una dimensione fondamentale: cos’è reale? Un po’ come domandava Morpheus a Neo in Matrix. I dati costituiscono da sempre il substrato delle organizzazioni. La ricerca 2026 segnala un indebolimento della fiducia in tale substrato. Il 61% dei leader riconosce la rilevanza del tema, ma solo il 5% riporta progressi sostanziali.

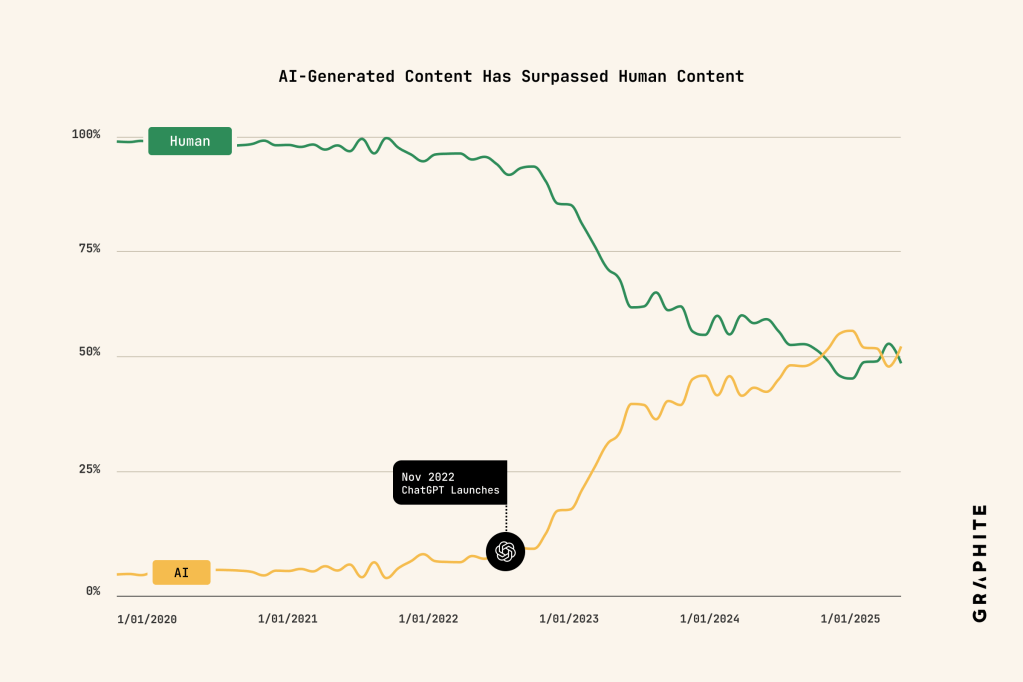

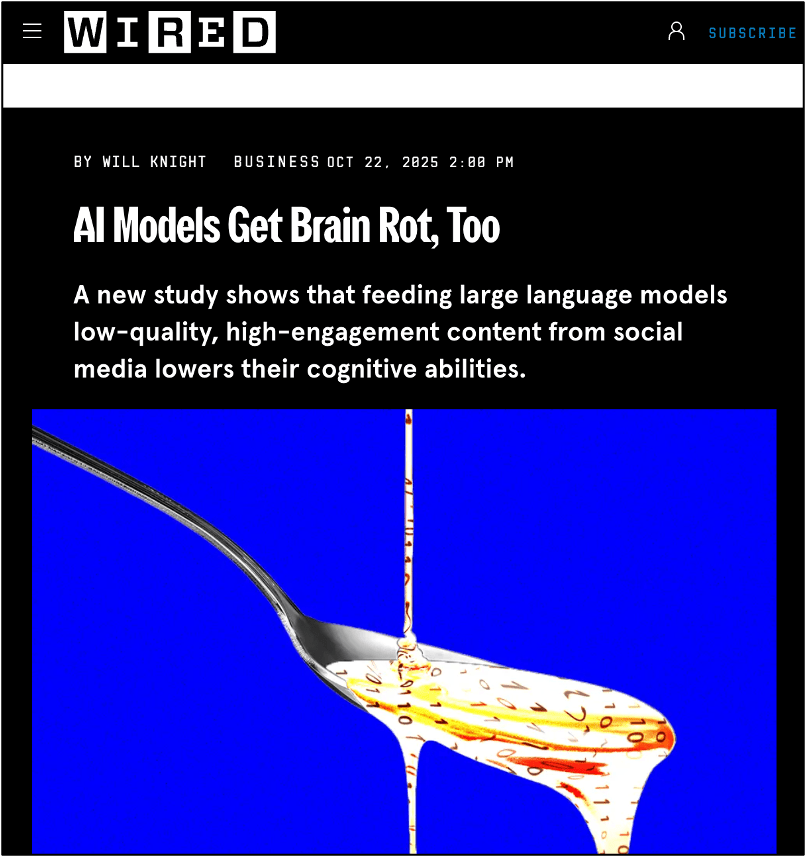

Oltre la metà dei nuovi articoli web a maggio 2025 risultava generata principalmente da AI, rispetto al 5% prima di ChatGPT. Il 95% degli executive esprime preoccupazione per l’accuratezza dei dati dei candidati; oltre un terzo dei lavoratori ammette di utilizzare l’AI per migliorare il proprio profilo. L’80% degli executive teme che l’AI venga usata per apparire più produttivi.

L’erosione riguarda autenticità, agency e giudizio. Il report lo esplicita:

“The real challenge is not only technical but also foundational: preserving meaning, authorship, and accountability in an age of synthetic intelligence.”

Direzione proposta.

Il passaggio indicato è verso la disinformation security e la costruzione di un digital trust pact. Tra le pratiche suggerite: tracciabilità della lineage dei dati, simulazioni di rischio e red-teaming, autenticazione dinamica delle identità umane e artificiali nei workflow.

Parallelamente, occorre investire sul giudizio umano. Formazione mirata per recruiter e manager, sviluppo della riflessività organizzativa, maggiore trasparenza negli output di lavoro. La fiducia richiede infrastrutture tecniche e maturità cognitiva.

AI and the future of human decision-making

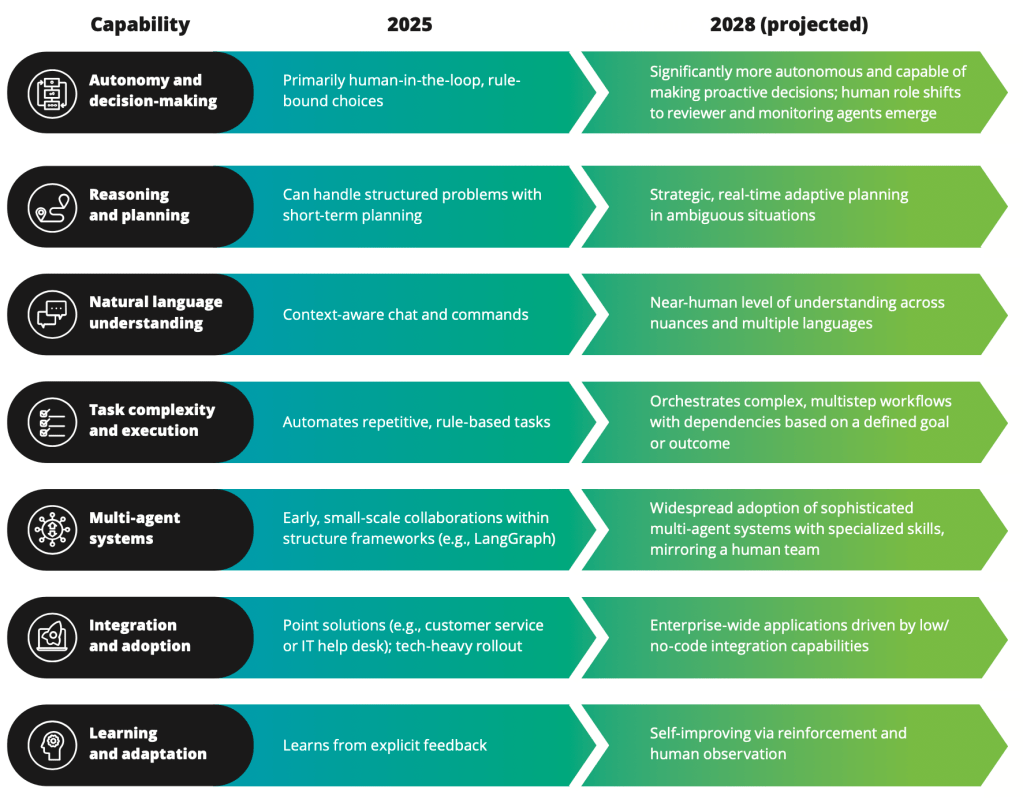

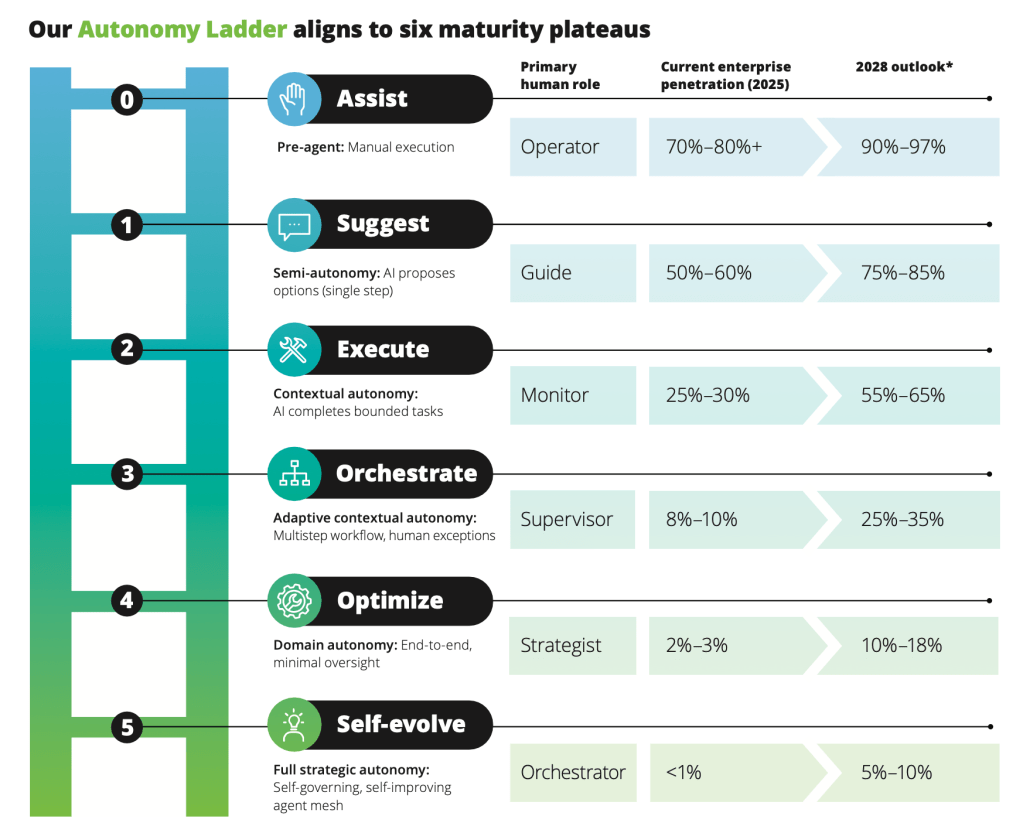

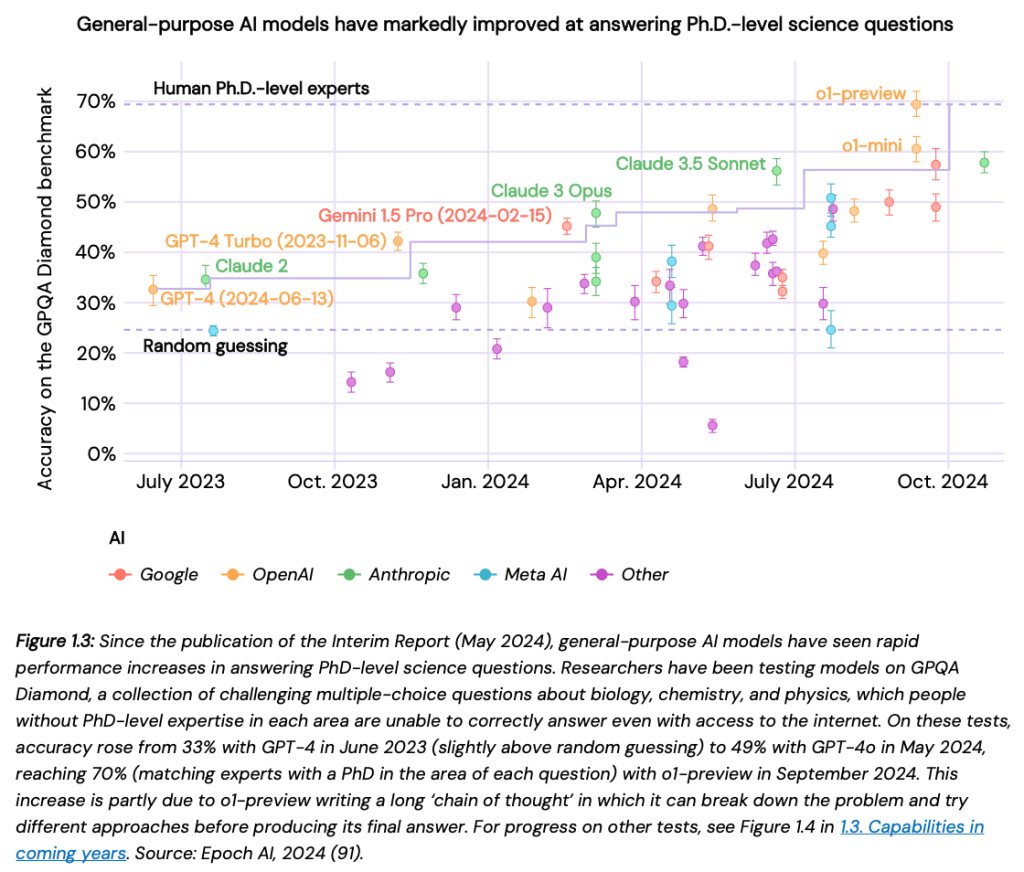

Il 60% degli executive utilizza l’AI a supporto delle decisioni. Entro il 2027, metà delle decisioni aziendali sarà aumentata o automatizzata da agenti AI. Solo il 5% delle organizzazioni si considera avanzato nella gestione di queste implicazioni, mentre il 64% ne riconosce l’importanza. Il report osserva:

“AI is reshaping organizational decisions, whether organizations are ready or not.”

Opacità, velocità e accountability distribuita ridefiniscono l’architettura decisionale. Inoltre, il 57% delle organizzazioni opera a un livello basso di maturità decisionale.

Direzione proposta.

Rendere esplicita la disciplina del decision-making: mappare le decisioni critiche, classificarle per rischio e reversibilità, assegnare ownership chiara. Progettare la relazione uomo–AI in modo strutturato, aggiornare diritti decisionali, definire override e percorsi di escalation. La governance richiede supervisione a livello di board e monitoraggio continuo delle performance dell’AI in termini di qualità, equità e affidabilità. L’autonomia dell’AI va calibrata in funzione del rischio decisionale.

Dealing with AI’s cultural debt

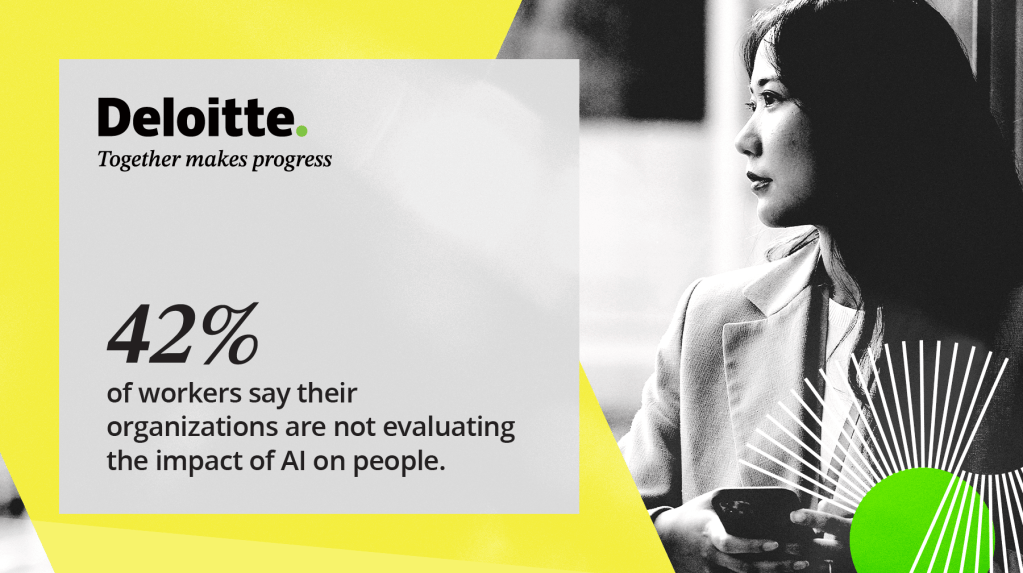

Il report introduce il concetto di cultural debt, ovvero l’accumulo di effetti negativi derivanti da un mancato governo dell’impatto culturale dell’AI. L’80% di leader, manager e lavoratori teme utilizzi opportunistici dell’AI. Il 42% dei lavoratori segnala che l’impatto dell’AI sulle persone viene raramente valutato. Solo il 5% delle organizzazioni riporta progressi concreti.

“Culture is built on a foundation of trust, and AI is breaking that trust in many ways.”

Direzione proposta.

Mappare la cultura attuale rispetto agli attributi desiderati, preservando senso di scopo e appartenenza e rafforzando innovazione e comunicazione aperta. Rendere esplicite le norme relative a equità, impegno e accountability nel lavoro mediato dall’AI. La leadership mantiene la responsabilità primaria dell’allineamento culturale.

Orchestrating capability and capacity at speed

La velocità sta superando la scala come principale driver di vantaggio competitivo. La ricerca evidenzia che la differenziazione dipende sempre più dalla rapidità con cui le organizzazioni riescono a riconfigurare capability attorno agli outcome strategici.

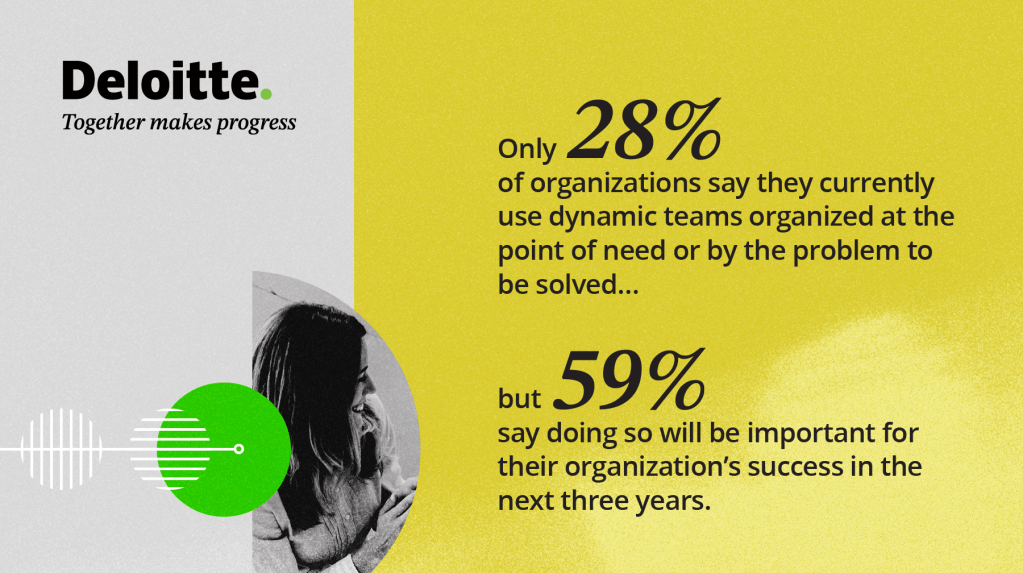

Molte organizzazioni non si muovono con sufficiente tempestività. Il vantaggio si sposta dall’allocazione statica del talento all’orchestrazione in tempo reale di persone, competenze, dati e tecnologia. Questo richiede il superamento di strutture rigide e la possibilità di combinare capability in modo fluido e dinamico.

Direzione proposta.

Le organizzazioni dovrebbero investire in sistemi che consentano la riconfigurazione continua dei team in funzione degli outcome, anziché dei ruoli formali. Marketplace interni delle competenze, modelli di staffing dinamici e visibilità sulle skill abilitata dall’AI diventano infrastrutture critiche. L’attenzione non riguarda esclusivamente la workforce planning, ma una vera e propria workforce orchestration.

Un elemento decisivo riguarda l’esperienza del lavoro. La sovraperformance finanziaria è correlata alla capacità di riconfigurare costantemente le capability preservando al contempo il significato e la qualità dell’esperienza professionale. In un contesto volatile, la capacità organizzativa va trattata come un asset adattivo, soggetto a riallocazione continua e intenzionale.

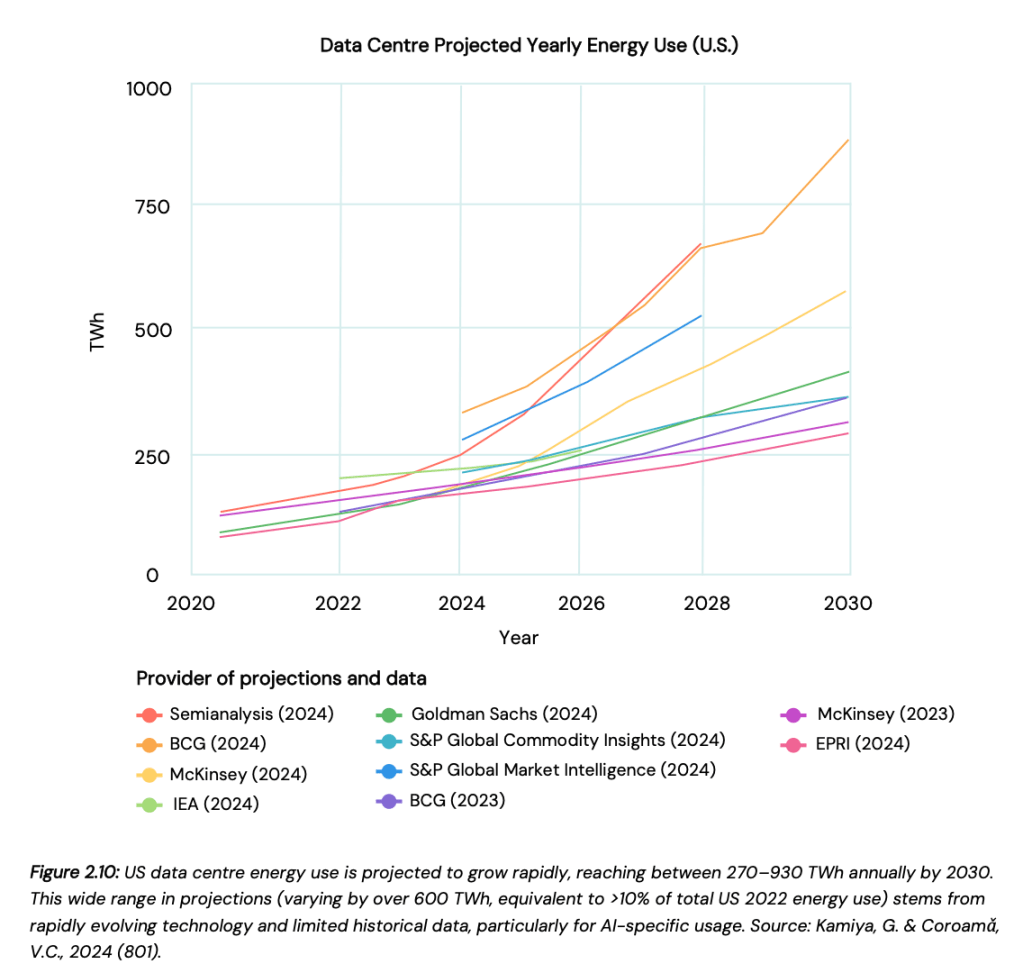

Getting more value from our functions

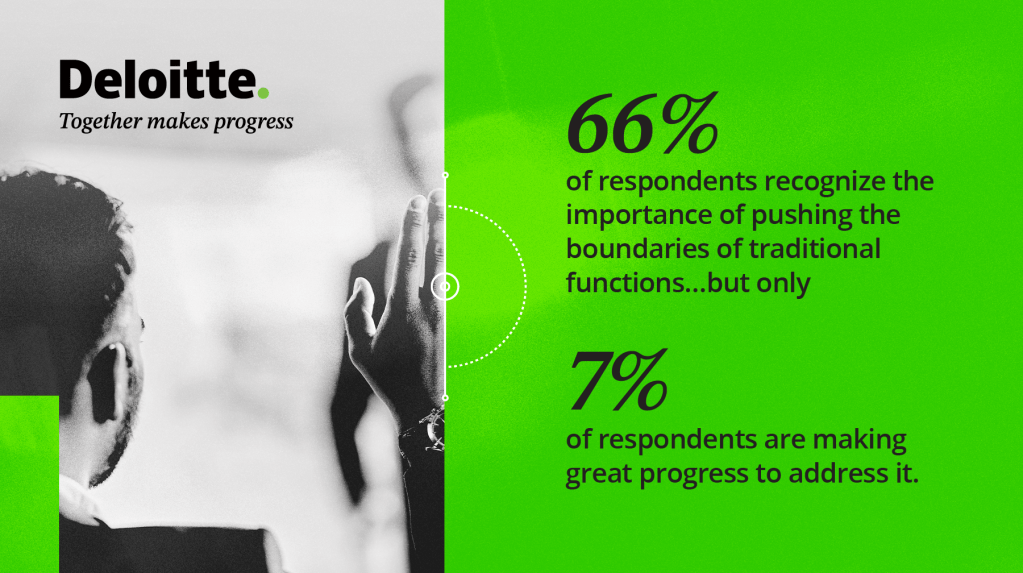

Con il passaggio dall’efficienza di costo alla creazione di valore, funzioni core come HR, Finance e IT sono sottoposte a una pressione strutturale crescente. I silos funzionali tradizionali risultano spesso troppo lenti, frammentati o rigidi rispetto alla velocità richiesta dal lavoro abilitato dall’AI.

Il report evidenzia che poche organizzazioni stanno compiendo progressi significativi nell’evolvere le funzioni oltre strutture e metriche legacy. Tuttavia, la crescente integrazione tra tecnologia, dati e persone rende sempre meno sostenibile una separazione netta tra domini funzionali. Le decisioni su automazione, workforce strategy, governance dei dati e architettura tecnologica sono interdipendenti.

La questione non riguarda solo l’efficienza operativa, ma la capacità delle funzioni di generare valore strategico in un contesto in cui l’AI modifica processi, ruoli e modelli di servizio.

Direzione proposta.

Le funzioni dovrebbero essere decostruite e riassemblate attorno agli outcome piuttosto che alle attività storicamente assegnate. I modelli di governance possono integrare in modo più stretto strategia tecnologica e people strategy, evitando duplicazioni e conflitti di priorità. Consigli o meccanismi cross-funzionali possono assumere la supervisione delle iniziative AI e delle scelte di innovazione con impatto sistemico.

I guadagni di efficienza generati dall’AI dovrebbero essere reinvestiti in innovazione, capacità analitica e sviluppo di nuove competenze. Le organizzazioni che si limitano a estrarre costo senza reinvestimento riducono la propria capacità di evoluzione. Quelle che utilizzano l’efficienza come leva per creare nuove fonti di valore costruiscono un vantaggio più resiliente.

How do we stay relevant?

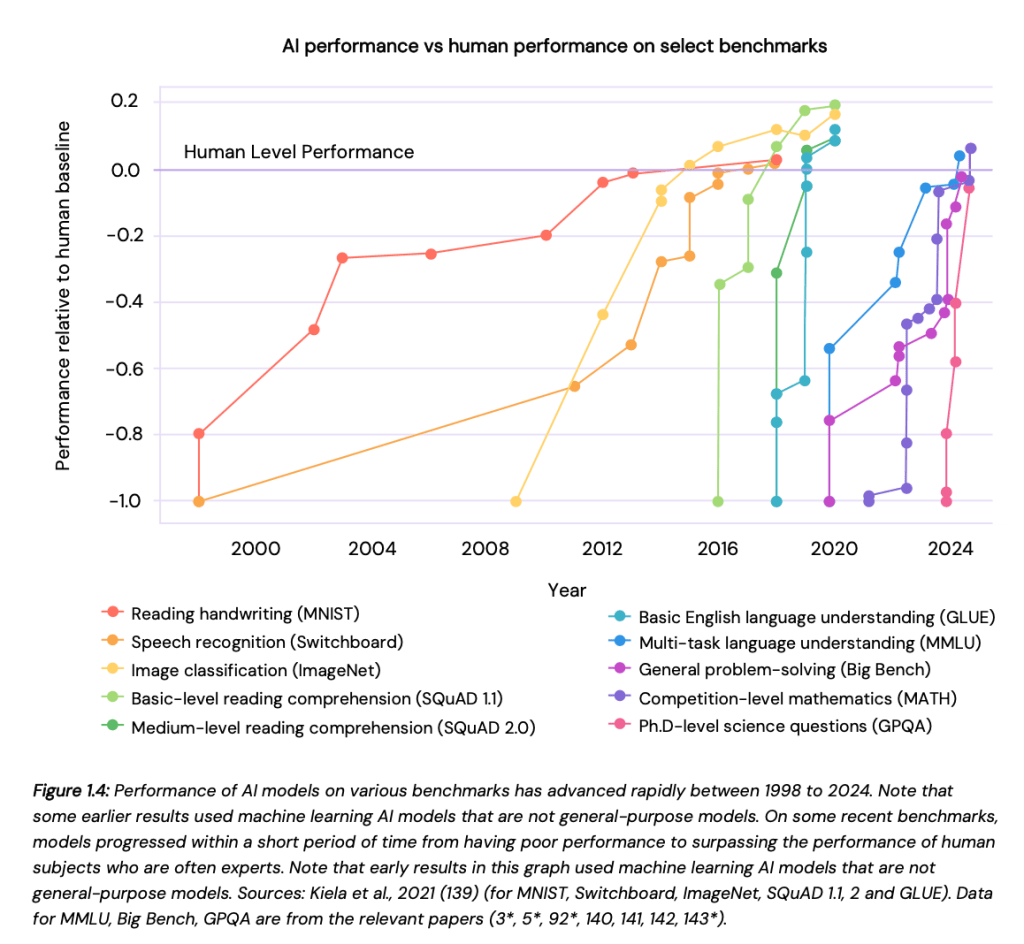

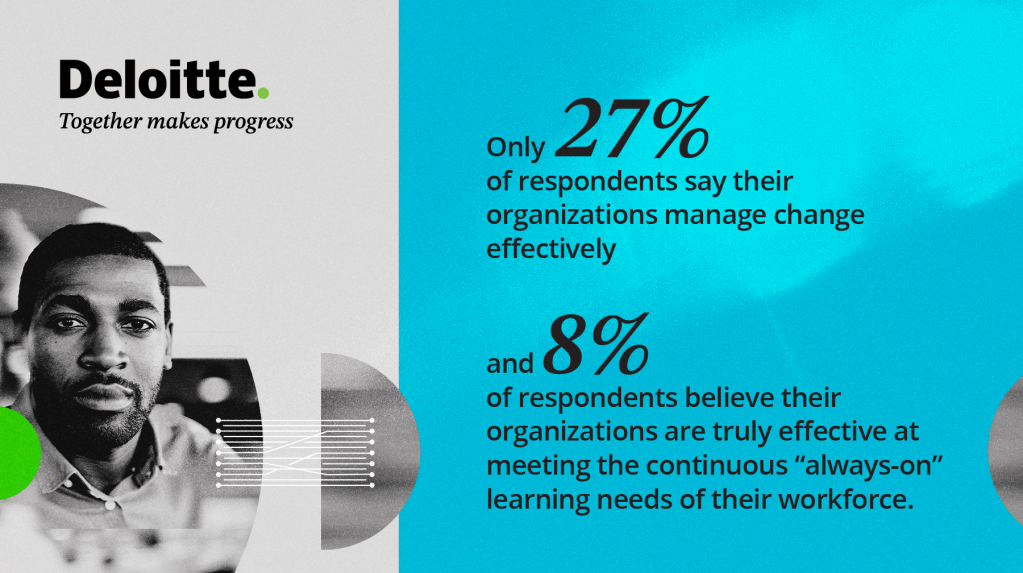

In un contesto di curva a S compressa, la rilevanza organizzativa diventa una variabile dinamica. Il report osserva che poche organizzazioni gestiscono il cambiamento in modo efficace e ancora meno riescono a soddisfare in modo sistematico le esigenze di apprendimento continuo della propria forza lavoro.

L’AI sta modificando sia il contenuto del lavoro sia le modalità di apprendimento. Abilita acquisizione di competenze nel flusso di attività, supporto decisionale in tempo reale e personalizzazione dei percorsi di sviluppo. La distanza tra trasformazione tecnologica e aggiornamento delle competenze rappresenta un rischio strategico.

La questione non è soltanto formativa, ma architetturale: riguarda la capacità dell’organizzazione di incorporare l’adattamento continuo nel proprio funzionamento ordinario.

Direzione proposta.

Costruire sistemi di apprendimento always-on, integrare feedback loop continui nei processi di lavoro e utilizzare strumenti AI per diagnosticare gap di competenze in modo tempestivo. La capacità di cambiare dovrebbe essere trattata come una competenza core dell’organizzazione, con responsabilità esplicite e metriche coerenti.

Strategia ed esecuzione tendono a convergere quando l’apprendimento è distribuito e continuo. I lavoratori dovrebbero essere messi nella condizione di aggiornare competenze e pratiche in modo progressivo, mantenendo l’allineamento con le priorità strategiche. La rilevanza non è uno stato acquisito, ma un processo sostenuto nel tempo.

Concluding reflection

“Building the human advantage is now as critical as managing technology itself.”

La ricerca individua una serie di tipping point che ridefiniscono le condizioni competitive. Le organizzazioni si trovano a operare in un ambiente in cui tecnologia, giudizio umano, cultura e fiducia interagiscono in modo sempre più stretto.

Riprogettare le relazioni uomo–macchina, rafforzare la fiducia nei dati, strutturare il decision-making, governare il debito culturale, orchestrare capability in modo dinamico, evolvere le funzioni e istituzionalizzare l’adattamento continuo sono scelte che incidono sulla traiettoria strategica di lungo periodo.

Il vantaggio umano richiede progettazione intenzionale, governance coerente e maturità organizzativa. In assenza di queste condizioni, l’adozione tecnologica tende a produrre frammentazione. In presenza di esse, diventa leva di evoluzione sistemica.